@devilloser

2018-09-06T02:48:46.000000Z

字数 1321

阅读 1027

Interaction-aware Spatio-temporal Pyramid Attention Networks for Action Classification

action

attention

attention主要是为了让model区分出无用信息

hard attention

make hard binary choices

soft attention

uses weighted average instead of hard selection

predict attention score of the next time by LSTM

self attention

a special form of non-local network

缺陷

在计算attention时都是对单独的frame计算attention,但是frame之间的interaction没有考虑

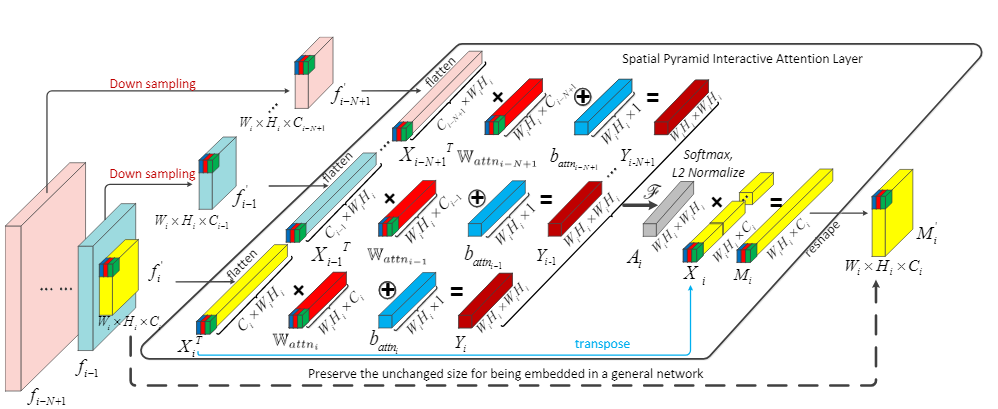

Interaction-aware Spatial Pyramid Attention Layer

对第i层的输出,flatten成

对层到第层,downsample成统一大小,即

流程如上图。

PCA

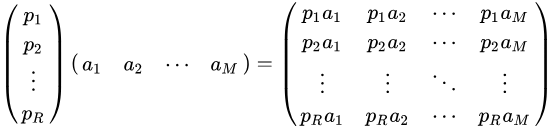

其中,是行向量,表示空间中第个基。

将X中的列向量投影到新的基底上。

跟PCA关系:

其中的认为是PCA中找到的一个新的基底,对不同channel的feature map作为样本,得到过滤后的feature map。

temporal aggregation

用表示K frames的数据。

loss fuction

PCA的目标是方差最大化,所以

拉格朗日方程:

interactive

为element sum,为element平方和

这里将第二项改为这种形式是因为做过L2 normalize,所以对角线都是1。